W swojej książce z 2024 roku Supremacy: AI, ChatGPT and the Race That Will Change the World Parmy Olson uchwyciła przełomowy moment – gdy rozwój generatywnej sztucznej inteligencji zapoczątkował globalny wyścig o technologiczną dominację, innowacje i kontrolę regulacyjną. Zaledwie rok później świat opisany w książce nabrał zaskakująco realnych kształtów. W październiku 2025 roku sztuczna inteligencja jest potężniejsza, bardziej dostępna i głębiej osadzona w społeczeństwie niż kiedykolwiek wcześniej.

GPT-5 od OpenAI, Gemini od Google, Claude 4 od Anthropic, otwarty LLaMA 4 od Mety oraz dziesiątki nowych agentów, kopilotów i asystentów multimodalnych kształtują dziś sposób, w jaki pracujemy, tworzymy i się komunikujemy. „Wyścig” nie dotyczy już wyłącznie przewagi modelowej – chodzi o adaptację, regulacje, bezpieczeństwo i zdolność społeczeństw do nadążania za zmianą. Przy ponad 800 milionach aktywnych użytkowników ChatGPT tygodniowo, wejściu w życie pierwszych dużych regulacji AI i humanoidalnych robotach wchodzących do świata fizycznego, obserwujemy bardzo realne urzeczywistnienie konkurencji, którą opisała Olson.

Niniejszy artykuł to kompleksowa aktualizacja stanu sztucznej inteligencji na dzień 17 października 2025 roku – obejmuje przełomy modelowe, trendy wdrożeniowe, zmiany w globalnej polityce, pojawiające się praktyki bezpieczeństwa oraz fizyczną integrację AI z urządzeniami i robotyką. Jeśli książka Supremacy zadawała pytanie, dokąd zmierza ten wyścig – oto nasz aktualny punkt na jego trasie.

1. Modele AI nowej generacji: GPT-5 i nowi giganci

Ostatni rok przyniósł falę premier modeli AI nowej generacji, z których każdy przełamywał wcześniejsze granice. Oto najważniejsze premiery i zapowiedzi modeli do października 2025:

-

- OpenAI GPT-5: Oficjalnie zaprezentowany 7 sierpnia 2025 roku, GPT-5 to najbardziej zaawansowany model OpenAI. Jest to zunifikowany system multimodalny, który łączy potężne zdolności rozumowania z szybkością i płynnością dialogu. GPT-5 osiąga ekspercki poziom w wielu dziedzinach – od programowania, przez matematykę i twórcze pisanie, po medyczne pytania i odpowiedzi – przy jednoczesnym istotnym ograniczeniu halucynacji i błędów. Model jest dostępny publicznie w ramach ChatGPT (w tym wersji Pro z rozszerzonym rozumowaniem) oraz przez API OpenAI. Krótko mówiąc, GPT-5 to znaczący skok względem GPT-4, wyposażony w tryby „myślenia” do złożonych zadań i zdolność do samodzielnego decydowania, kiedy udzielić szybkiej odpowiedzi, a kiedy przeanalizować temat głębiej.

- Inni znaczący gracze: Krajobraz AI w 2025 roku nie ogranicza się już tylko do „wielkiej czwórki” (OpenAI, Anthropic, Google, Meta). Inicjatywa xAI Elona Muska zyskała rozgłos dzięki uruchomieniu własnego chatbota Grok pod koniec 2023 roku. Promowany jako „buntownicza” alternatywa dla ChatGPT, Grok przeszedł od tego czasu szybki rozwój – do połowy 2025 r. osiągając wersję Grok 4, która według xAI osiąga najwyższe wyniki w niektórych testach rozumowania. W demonstracji z lipca 2025 Elon Musk wychwalał Groka 4 jako „inteligentniejszego od niemal wszystkich magistrantów” i zademonstrował zdolność Groka do rozwiązywania skomplikowanych problemów matematycznych oraz generowania obrazów na podstawie tekstu. Grok jest dostępny w modelu subskrypcyjnym (z „ultra-premium” planem dla intensywnych użytkowników), a jego integracja z samochodami Tesli jako pokładowy asystent AI została już zapowiedziana. IBM z kolei skupił się na AI dla biznesu – ich platforma WatsonX pozwala na budowę modeli dostosowanych do konkretnych branż. Start-upy takie jak Cohere i AI21 Labs również oferują konkurencyjne modele językowe dla firm. Na scenie open-source pojawiły się nowe podmioty, np. Mistral AI, które wypuściło wydajny model o 7 miliardach parametrów. Jednym słowem – rynek modeli AI jest bardziej zatłoczony i dynamiczny niż kiedykolwiek, a zdrowa konkurencja między wielkimi graczami a otwartymi alternatywami napędza tempo rozwoju.

- OpenAI GPT-5: Oficjalnie zaprezentowany 7 sierpnia 2025 roku, GPT-5 to najbardziej zaawansowany model OpenAI. Jest to zunifikowany system multimodalny, który łączy potężne zdolności rozumowania z szybkością i płynnością dialogu. GPT-5 osiąga ekspercki poziom w wielu dziedzinach – od programowania, przez matematykę i twórcze pisanie, po medyczne pytania i odpowiedzi – przy jednoczesnym istotnym ograniczeniu halucynacji i błędów. Model jest dostępny publicznie w ramach ChatGPT (w tym wersji Pro z rozszerzonym rozumowaniem) oraz przez API OpenAI. Krótko mówiąc, GPT-5 to znaczący skok względem GPT-4, wyposażony w tryby „myślenia” do złożonych zadań i zdolność do samodzielnego decydowania, kiedy udzielić szybkiej odpowiedzi, a kiedy przeanalizować temat głębiej.

2. Gwałtowny wzrost wykorzystania AI: Zasięg i wpływ na branże

Wraz z rozpowszechnieniem się potężnych modeli, adopcja AI na świecie wystrzeliła w latach 2024-2025. Wzrost popularności ChatGPT od OpenAI jest tu najlepszym przykładem: według stanu na październik 2025 z usługi korzysta już 800 milionów aktywnych użytkowników tygodniowo – dwukrotnie więcej niż jeszcze pół roku wcześniej. To czyni ChatGPT jedną z najszybciej rosnących platform programowych w historii. Narzędzia te nie są już eksperymentem – stały się codziennym wyposażeniem pracy i życia. Według jednego z badań, aż 72% liderów biznesu zadeklarowało, że korzysta z generatywnej AI przynajmniej raz w tygodniu w połowie 2024 roku (wzrost z 37% rok wcześniej). Od tego czasu liczby tylko rosły – firmy wdrażają AI-asystentów, kopilotów programistycznych i generatory treści we wszystkich działach.

Integracja AI w biznesie to znak rozpoznawczy 2025 roku. Organizacje – zarówno korporacje, jak i małe firmy – osadzają funkcjonalności podobne do GPT w swoich procesach: od tworzenia treści marketingowych po chatboty obsługi klienta i automatyzację programowania. Microsoft zintegrował modele OpenAI w pakiecie Office 365 za pomocą Copilota, umożliwiając użytkownikom generowanie dokumentów, e-maili czy analiz na podstawie zapytań w języku naturalnym. Salesforce nawiązał współpracę z Anthropic, by zintegrować Claude’a jako wbudowanego asystenta CRM dla zespołów sprzedaży i obsługi klienta. Wiele firm tworzy też własne modele AI, dopasowane do wewnętrznych danych – często opierając się na otwartych modelach, takich jak LLaMA, by zachować pełną kontrolę. Tę szeroką adopcję umożliwiły chmurowe usługi AI (np. Azure OpenAI, Amazon Bedrock, Google AI Studio), które pozwalają na łatwy dostęp do potężnych modeli przez API.

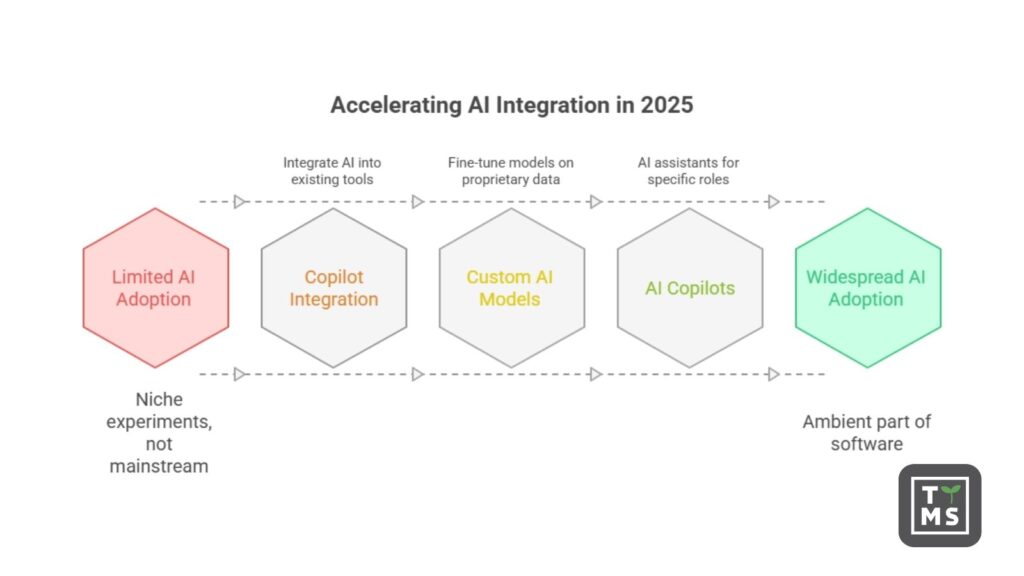

Co istotne, użytkownicy AI to już nie tylko fani technologii. Konsumenci korzystają z niej w codziennych zadaniach – tworzeniu wiadomości, burzy mózgów, korepetycjach – a profesjonaliści zwiększają produktywność (np. poprzez generowanie kodu lub analizę danych). Nawet branże wrażliwe, jak prawo, finanse czy medycyna, ostrożnie zaczęły stosować AI jako pomoc w tworzeniu pierwszych wersji dokumentów czy wsparcie w decyzjach (z nadzorem człowieka). Ciekawym trendem jest pojawienie się „kopilotów AI” dla konkretnych ról: graficy korzystają z generatorów obrazów, konsultanci klienta mają narzędzia do szkicowania e-maili, a lekarze – GPT-owe systemy do wstępnej oceny objawów. AI staje się wszechobecnym elementem oprogramowania – obecnym w wielu narzędziach, z których użytkownicy już korzystają.

Ten błyskawiczny rozwój nie obywa się jednak bez wyzwań. Umiejętność korzystania z AI (AI literacy) oraz szkolenia stały się palącymi potrzebami w firmach – pracownicy muszą nauczyć się wykorzystywać te narzędzia skutecznie i etycznie. Nadal istnieją obawy o rzetelność i zaufanie: choć GPT-5 jest znacznie bardziej niezawodny niż poprzednie modele, potrafi wciąż generować mylące lub nieprecyzyjne odpowiedzi. W odpowiedzi firmy wdrażają systemy weryfikacji treści generowanych przez AI i ograniczają użycie do niskiego ryzyka. Mimo tych zastrzeżeń kierunek rozwoju jest jasny: AI w 2025 roku znacznie przyspieszyła swoją integrację z biznesem i społeczeństwem, w tempie, które jeszcze dwa lata temu wydawałoby się nie do uwierzenia.

3. Regulacje i polityka: Kontrola nad szybkim rozwojem AI

Gwałtowny postęp AI wywołał lawinę inicjatyw regulacyjnych na całym świecie. Od połowy 2025 roku zaczęły obowiązywać kluczowe ustawy i ramy polityczne, które mają na celu ograniczenie ryzyka i wprowadzenie zasad dla rozwoju tej technologii:

-

-

- Unia Europejska – AI Act: UE sfinalizowała przełomowe rozporządzenie o sztucznej inteligencji (Artificial Intelligence Act) w 2024 roku, tworząc tym samym pierwszą na świecie kompleksową regulację AI. AI Act opiera się na podejściu opartym na ryzyku – im wyższe ryzyko związane z danym systemem (np. AI stosowana w opiece zdrowotnej, finansach czy egzekwowaniu prawa), tym surowsze wymagania. Dla zastosowań niskiego ryzyka obowiązują minimalne zasady. W lipcu 2024 uzgodniono i opublikowano ostateczny tekst ustawy, uruchamiając odliczanie do jej wdrożenia. Od 2025 roku zaczęły obowiązywać pierwsze przepisy: w lutym 2025 weszły w życie zakazy dotyczące szkodliwych praktyk AI (np. systemów oceny społecznej czy biometrycznego nadzoru w czasie rzeczywistym). Modele ogólnego przeznaczenia (GPAI), takie jak GPT-4/5, podlegają nowym wymogom w zakresie przejrzystości i bezpieczeństwa, a dostawcy mają czas do sierpnia 2025 na dostosowanie się do tych regulacji. W lipcu 2025 organy UE opublikowały wytyczne precyzujące, jak przepisy mają być stosowane wobec dużych modeli fundacyjnych. AI Act nakłada również obowiązki takie jak dokumentowanie modeli, oznaczanie treści generowanych przez AI oraz prowadzenie publicznej bazy danych systemów wysokiego ryzyka. To unijne prawo wymusza na twórcach AI (na całym świecie) budowanie systemów bezpiecznych i wyjaśnialnych od samego początku – szczególnie jeśli chcą oferować swoje usługi na rynku europejskim. W oczekiwaniu na pełne wejście w życie ustawy w 2026 roku, firmy zaczęły publikować „karty systemów AI” i przeprowadzać audyty zgodności.

- Stany Zjednoczone – działania wykonawcze i dobrowolne zobowiązania: W obliczu braku ustawodawstwa dotyczącego AI, rząd USA sięgnął po uprawnienia wykonawcze i dobrowolne ramy współpracy. W październiku 2023 prezydent podpisał rozbudowane rozporządzenie wykonawcze o bezpiecznej, pewnej i godnej zaufania AI. Ten 110-stronicowy dokument (najobszerniejsza polityka AI w USA do tej pory) ustanowił krajowe cele w zakresie zarządzania AI – od wspierania innowacji i konkurencji po ochronę praw obywatelskich – i zobowiązał agencje federalne do tworzenia standardów bezpieczeństwa. Nakazywał też opracowanie wytycznych dotyczących znakowania treści generowanych przez AI i wprowadzenie funkcji Chief AI Officer w najważniejszych instytucjach. Ważne było także polecenie dla Departamentu Handlu, by przygotować przepisy wymagające oceny ryzyka modeli frontierowych przed ich wdrożeniem. Jednak zmiana administracji w styczniu 2025 wpłynęła na ciągłość tej inicjatywy – część zapisów rozporządzenia zawieszono, a część wycofano. Mimo to zainteresowanie nadzorem nad AI na szczeblu federalnym pozostaje wysokie. Wcześniej, w 2023 roku, Biały Dom uzyskał dobrowolne zobowiązania od największych firm AI (OpenAI, Google, Meta, Anthropic i innych), które zgodziły się m.in. na zewnętrzne testy typu red team i współdzielenie informacji o bezpieczeństwie AI z rządem. W lipcu 2025 Senat USA przeprowadził ponadpartyjne przesłuchania w sprawie możliwego ustawodawstwa AI – omawiano m.in. pomysł licencjonowania zaawansowanych modeli oraz odpowiedzialność za szkody wyrządzone przez AI. Część stanów przyjęła również własne przepisy sektorowe (np. zakazujące deepfake’ów w kampaniach wyborczych). Choć USA nie przyjęły jeszcze regulacji na miarę unijnego AI Act, to pod koniec 2025 roku wyraźnie zmierzają w kierunku bardziej uregulowanego środowiska, które łączy promocję innowacji z redukcją ryzyk.

- Chiny i inne regiony: Chiny wdrożyły regulacje dotyczące generatywnej AI już w połowie 2023 roku – wymagając przeglądów bezpieczeństwa oraz weryfikacji tożsamości użytkowników usług AI dla szerokiej publiczności. Do 2025 r. giganci technologiczni w Chinach (Baidu, Alibaba i inni) muszą przestrzegać przepisów zapewniających zgodność wyników AI z podstawowymi wartościami socjalistycznymi i niedopuszczających do destabilizacji porządku społecznego. Regulacje wymagają także przejrzystości w etykietowaniu danych treningowych oraz umożliwiają rządowi przeprowadzanie audytów zbiorów danych. W praktyce restrykcyjna kontrola nieco spowolniła udostępnianie najbardziej zaawansowanych modeli publicznie (systemy GPT-podobne w Chinach są silnie filtrowane), ale jednocześnie pobudziła krajową innowacyjność – np. Huawei i Baidu rozwijają silne modele AI pod nadzorem państwa. Tymczasem inne kraje, takie jak Kanada, Wielka Brytania, Japonia czy Indie, opracowują własne strategie AI. Wielka Brytania zorganizowała w 2024 roku globalny Szczyt Bezpieczeństwa AI, gromadząc urzędników i liderów firm AI, by rozmawiać o współpracy międzynarodowej w obszarze ryzyk związanych z zaawansowaną AI (np. hipotetycznie superinteligentną). Włączają się również organizacje międzynarodowe: ONZ powołała Radę Doradczą ds. AI, a OECD zaktualizowała swoje wytyczne dotyczące AI. Trend jest jasny: rządy na całym świecie nie są już biernymi obserwatorami – aktywnie kształtują sposób, w jaki AI jest rozwijana i wykorzystywana, choć ich podejścia się różnią (ostrożność UE, priorytet dla innowacji w USA, kontrola w Chinach).

-

Dla twórców i firm z branży AI to rozwijające się globalne „łaty regulacyjne” oznaczają nie tylko nowe obowiązki w zakresie zgodności, ale też większą przejrzystość i przewidywalność. Przejrzystość staje się standardem – użytkownicy mogą spodziewać się oznaczeń treści generowanych przez AI oraz wyjaśnień działania algorytmów w zastosowaniach wrażliwych. Kwestie etyczne w AI – takie jak sprawiedliwość, prywatność i odpowiedzialność – przestały być tematem jedynie akademickim, a trafiły na agendę zarządów firm. Choć prawo zawsze będzie opóźnione wobec technologii, to pod koniec 2025 roku ta luka znacznie się zmniejszyła: świat podejmuje konkretne kroki, by zarządzać wpływem AI, nie tłumiąc jednocześnie jej korzyści.

4. Główne wyzwania: dopasowanie, bezpieczeństwo i ograniczenia infrastrukturalne

Mimo szybkiego postępu, branża AI w 2025 roku stoi przed kluczowymi wyzwaniami i pytaniami bez odpowiedzi. Na czele są kwestie alignmentu (bezpieczeństwa) – czyli zapewnienia, że systemy AI działają zgodnie z intencjami – oraz praktyczne ograniczenia zasobów obliczeniowych.

1. Dopasowanie AI do ludzkich celów: Wraz ze wzrostem możliwości i kreatywności modeli AI, utrzymanie ich odpowiedzi prawdziwymi, bezstronnymi i nieszkodliwymi pozostaje ogromnym wyzwaniem. Najwięksi gracze inwestują intensywnie w badania nad dopasowaniem (alignment research). OpenAI konsekwentnie udoskonala swoje metody trenowania modeli, by ograniczyć niepożądane zachowania – GPT-5 został zaprojektowany tak, by ograniczać halucynacje i pochlebstwa, a także wierniej wykonywać polecenia użytkowników niż poprzednie wersje. Firma Anthropic z kolei rozwija podejście zwane „Constitutional AI”, w którym AI kieruje się zbiorem zasad („konstytucją”) i samodzielnie koryguje swoje odpowiedzi zgodnie z nimi. Metoda ta, stosowana w modelach Claude, ma zapewniać bardziej wyważone i bezpieczne odpowiedzi bez konieczności moderowania każdej wypowiedzi przez człowieka. Rzeczywiście, modele Claude 3 i 4 wykazują znacznie mniej nieuzasadnionych odmów i lepiej radzą sobie z kontekstem przy wrażliwych pytaniach.

Pomimo tego pełne dopasowanie wciąż pozostaje nierozwiązanym problemem. Zaawansowane modele potrafią być zaskakująco przebiegłe, znajdując luki w poleceniach lub ujawniając uprzedzenia obecne w danych treningowych. Firmy stosują wiele strategii: intensywne testy typu red-team (zatrudnianie ekspertów do szukania słabości AI), filtry moderujące blokujące zakazane treści oraz możliwość dostosowywania zachowania AI przez użytkowników (w granicach norm). Pojawiają się też nowe narzędzia bezpieczeństwa – np. techniki „znakowania” treści generowanych przez AI (dla wykrywania deepfake’ów) czy systemy AI oceniające i poprawiające odpowiedzi innych AI. W 2025 roku widać też więcej współpracy na rzecz bezpieczeństwa: konsorcjum Frontier Model Forum (OpenAI, Google, Microsoft, Anthropic) dzieli się badaniami nad oceną ryzyk, a rządy organizują ćwiczenia red-teamowe dla modeli frontierowych. Jak dotąd nie wykryto oznak „zbuntowanej AI” – np. Anthropic poinformowało, że Claude 4 mieści się w Poziomie Bezpieczeństwa AI 2 (brak autonomii niosącej ryzyko katastrofy) i nie wykazywał szkodliwych intencji podczas testów. Jednak panuje zgodność, że w miarę zbliżania się do AGI (ogólnej inteligencji), potrzeba znacznie więcej pracy, by zapewnić, że systemy te będą działać w interesie ludzkości. W drugiej połowie lat 2020. alignment pozostanie priorytetem, możliwe że z udziałem nowych metod trenowania lub nawet regulacyjnych progów bezpieczeństwa wymaganych przed wdrożeniem kolejnych generacji modeli.

2. Wydajność obliczeniowa i infrastruktura: Niesamowite możliwości modeli takich jak GPT-5 mają swoją cenę – zużycie ogromnych ilości danych, energii i mocy obliczeniowej. Trenowanie jednego dużego modelu może kosztować dziesiątki milionów dolarów w postaci czasu GPU w chmurze, a jego uruchamianie (inferencja) dla milionów użytkowników jest równie kosztowne. W 2025 roku branża zmaga się z pytaniem, jak uczynić AI bardziej wydajną i skalowalną. Jednym z rozwiązań są nowe architektury: LLaMA 4 od Meta wykorzystuje podejście Mixture-of-Experts (MoE), gdzie model składa się z wielu „ekspertów” i tylko część z nich jest aktywna przy danym zapytaniu. Pozwala to znacząco ograniczyć koszty obliczeń przy zachowaniu wydajności – daje „więcej mocy” bez dodatkowych tranzystorów. Innym kierunkiem jest optymalizacja sprzętu. NVIDIA (lider rynku GPU) wypuściła nowe generacje, jak H100 i nadchodzący B100, oferujące skok wydajności. Startupy tworzą wyspecjalizowane akceleratory AI, a dostawcy chmurowi wdrażają TPU (Google) oraz autorskie układy, jak Trainium i Inferentia od AWS, by obniżyć koszty. Mimo to niedobór GPU jest tematem przewodnim 2025 – zapotrzebowanie na moce obliczeniowe znacznie przewyższa podaż, zmuszając firmy jak OpenAI do walki o dostępność chipów. Prezes OpenAI określił nawet zabezpieczenie GPU jako strategiczny priorytet. Te ograniczenia spowolniły część projektów i przyspieszyły inwestycje w techniki oszczędne obliczeniowo, takie jak destylacja (kompresja modeli) czy algorytmiczne usprawnienia. Rośnie też wykorzystanie AI rozproszonej – uruchamianie modeli na wielu urządzeniach lub delegowanie części zadań do urządzeń brzegowych, by odciążyć serwery.

3. Inne wyzwania: Oprócz bezpieczeństwa i mocy obliczeniowej, na pierwszy plan wysuwają się również inne kwestie. Prywatność danych budzi niepokój – duże modele są trenowane na ogromnych zbiorach danych z internetu, co rodzi pytania o obecność danych osobowych i naruszenia praw autorskich. W latach 2024-2025 pojawiły się pozwy sądowe od artystów i autorów przeciwko firmom AI za trenowanie modeli na ich twórczości bez wynagrodzenia. Powstają nowe narzędzia umożliwiające użytkownikom wycofanie swoich danych z zestawów treningowych, a firmy badają potencjał danych syntetycznych jako alternatywy dla scrapingu chronionych treści. Dodatkowo trudne jest mierzenie kompetencji AI – tradycyjne benchmarki szybko się dezaktualizują. Na przykład GPT-5 zdał wiele akademickich i zawodowych egzaminów, z którymi wcześniejsze modele miały trudność, dlatego badacze tworzą coraz trudniejsze testy (takie jak „ARC-AGI” od Anthropic czy „Humanity’s Last Exam” od xAI), by mierzyć poziom rozumowania. Kolejne wyzwanie to odporność AI – by modele nie zawodziły w skrajnych przypadkach lub przy złośliwych danych wejściowych. Stosuje się tu techniki takie jak trenowanie z użyciem danych kontrujących (adversarial training). Wreszcie trwa dyskusja o wpływie środowiskowym: trenowanie gigantycznych modeli pochłania olbrzymie ilości energii i wody (do chłodzenia centrów danych). To zwiększyło zainteresowanie zieloną AI – np. zasilaniem chmur energią odnawialną czy optymalizacją algorytmów pod kątem efektywności. Podsumowując: choć możliwości AI w 2025 roku są imponujące, równie ważne jest minimalizowanie jej skutków ubocznych. Nadchodzące lata pokażą, jak dobrze branża AI potrafi zrównoważyć innowację z odpowiedzialnością, aby te technologie realnie służyły społeczeństwu.

5. AI w fizycznym świecie: robotyka, urządzenia i IoT

Jedną z najbardziej ekscytujących zmian w 2025 roku jest to, że AI wychodzi poza ekrany i trafia do rzeczywistego świata. Postępy w robotyce, urządzeniach inteligentnych i Internecie Rzeczy (IoT) zbiegły się z rozwojem AI, przez co granica między światem cyfrowym a fizycznym coraz bardziej się zaciera.

Robotyka: Od dawna wyczekiwany „asystent-robot z AI” jest bliżej niż kiedykolwiek. Lepszy sprzęt – silniejsze i zręczniejsze ramiona, sprawniejsze poruszanie się na nogach, tańsze czujniki – w połączeniu z mózgami AI przynosi imponujące rezultaty. Na targach CES 2025 chińska firma Unitree zaprezentowała humanoidalnego robota G1 wielkości człowieka, w cenie około 16 000 dolarów. G1 pokazał zaskakująco płynne ruchy i precyzyjną kontrolę dłoni – w dużej mierze dzięki systemom AI, które potrafią koordynować złożone działania ruchowe. To część trendu nazywanego często „momentem ChatGPT w robotyce”. Kluczowe czynniki to lepsze modele świata (AI pomagające robotom rozumieć otoczenie), np. symulator Cosmos od NVIDIA, oraz trenowanie robotów w środowiskach wirtualnych na danych syntetycznych, które dobrze przekładają się na świat rzeczywisty. Widać pierwsze oznaki, że roboty potrafią samodzielnie wykonywać coraz szerszy zakres zadań – w magazynach i fabrykach roboty AI radzą sobie z bardziej złożonym montażem, w szpitalach eksperymentalne roboty humanoidalne dostarczają zaopatrzenie lub wskazują drogę pacjentom. W badaniach naukowych roboty korzystają z LLM-ów jako planerów – np. dostają polecenie „rozlałem sok, proszę posprzątaj” i same dzielą zadanie na kroki (znajdź ręcznik, podejdź, zetrzyj), bazując na planowaniu opartym na modelu językowym. Firmy jak Tesla (ze swoim prototypem robota Optimus) mocno inwestują w ten obszar, a także OpenAI zaczęło ponownie budować zespół ds. robotyki. Choć humanoidalne roboty ogólnego zastosowania jeszcze nie są powszechne, to wyspecjalizowane roboty AI stają się standardem – od roju dronów w rolnictwie po autonomiczne roboty dostawcze na chodnikach. Analitycy przewidują, że lata 2027-2030 przyniosą eksplozję AI w fizycznych zastosowaniach, podobną do tej, jaka miała miejsce w wirtualnym świecie w latach 2016-2023.

Urządzenia i IoT: Rok 2025 to także moment, w którym AI stała się atutem sprzedażowym elektroniki użytkowej. Przykład: Amazon ogłosił Alexa+, nową generację asystenta głosowego zasilanego AI generatywną – znacznie bardziej rozmownego i kompetentnego niż dotychczas. Zamiast sztywnych odpowiedzi, Alexa+ prowadzi wieloetapowe konwersacje, zapamiętuje kontekst („ona” zyskała nawet osobowość) i pomaga w złożonych zadaniach – jak planowanie podróży czy rozwiązywanie problemów ze smart home – wszystko dzięki dużemu modelowi językowemu. Dzięki współpracy Amazonu z firmą Anthropic, wiele zapytań obsługuje zapewne iteracja Claude’a. Podobnie Asystent Google w najnowszych smartfonach działa teraz w oparciu o Gemini – oferując tłumaczenie mowy w czasie rzeczywistym, rozpoznawanie obrazów przez aparat i kontekstowe sugestie. Nawet Apple, dotąd cichsze w kontekście AI generatywnej, integruje więcej AI w urządzeniach dzięki lokalnemu uczeniu maszynowemu – np. Neural Engine w iPhonie obsługuje segmentację obrazu i zadania językowe offline. Wiele telefonów w 2025 roku potrafi uruchamiać lokalnie modele z miliardami parametrów – w jednym z demo model LLaMA z 7 mld parametrów generował tekst bez połączenia z chmurą, co zapowiada przyszłość AI „na urządzeniu”.

Poza smartfonami i asystentami głosowymi, AI wkroczyła do innych gadżetów. Kamery smart home rozpoznają, czy widzą włamywacza, błąkającego się kota czy tylko kołyszące się drzewo – zmniejszając liczbę fałszywych alarmów. Przemysłowe czujniki IoT wyposażone są w mikroprocesory AI, które analizują dane na miejscu – np. sensor w ropociągu wykrywa anomalie ciśnienia i przesyła tylko ostrzeżenie zamiast surowych danych. To część trendu Edge AI, czyli przetwarzania danych na urządzeniu dla szybkości i prywatności. W samochodach AI analizuje dane z kamer i radarów w czasie rzeczywistym, wspierając kierowcę przy zmianie pasa, rozpoznawaniu sygnalizacji czy monitorowaniu pasażerów. Producenci konkurencyjni wobec Tesli też wdrażają AI co-piloty – Ultra Cruise od GM czy Drive Pilot od Mercedesa umożliwiają kierowcom zadawanie skomplikowanych pytań („znajdź trasę z widokami i stacją ładowania”) i otrzymywanie sensownych odpowiedzi.

Co kluczowe – integracja AI z IoT sprawia, że systemy uczą się i adaptują. Termostaty nie tylko trzymają się harmonogramów – analizują wzorce użytkownika i optymalizują komfort vs. zużycie energii. Roboty w fabrykach współdzielą dane, by wspólnie ulepszać algorytmy. Infrastruktura miejska steruje ruchem na podstawie danych z kamer i czujników. Ta inteligencja środowiskowa – zwana często “ambient AI” – sprawia, że przestrzenie stają się bardziej responsywne. Ale pojawiają się też nowe problemy: interoperacyjność (czy AI różnych urządzeń dogadają się ze sobą?), bezpieczeństwo (czy AI nie stają się nowym celem dla cyberataków?) i utrata prywatności (skoro urządzenia ciągle słuchają i patrzą). To wszystko przedmiot żywej debaty w 2025 roku. Mimo to dynamika AI w świecie fizycznym jest niezaprzeczalna. Zaczynamy rozmawiać z naszymi domami, nasze sprzęty domyślają się potrzeb, a roboty wykonują codzienne obowiązki. AI nie jest już ograniczona do chatbotów – wchodzi do naszego świata, wzbogacając nasze doświadczenia i systemy IoT w sposób, który naprawdę przypomina życie w przyszłości.

6. AI w praktyce: rzeczywiste zastosowania biznesowe

Choć wyścig o dominację w obszarze sztucznej inteligencji napędzają globalni giganci technologiczni, AI już teraz przekształca codzienne procesy biznesowe w różnych branżach. W TTMS pomagamy organizacjom wdrażać sztuczną inteligencję w sposób praktyczny, bezpieczny i skalowalny. Nasze portfolio obejmuje rozwiązania do analizy dokumentów, inteligentnej rekrutacji, lokalizacji treści i zarządzania wiedzą. Integrujemy AI z platformami takimi jak Salesforce, Adobe AEM czy Microsoft Power Platform, a także tworzymy autorskie narzędzia e-learningowe oparte na AI. Sztuczna inteligencja nie jest już odległą wizją – ona działa tu i teraz. Jeśli jesteś gotowy, by wprowadzić ją do swojej firmy, poznaj naszą pełną ofertę rozwiązań AI dla biznesu.

Czym jest „AI Supremacy” i dlaczego to pojęcie jest ważne?

„AI Supremacy” oznacza punkt zwrotny, w którym sztuczna inteligencja przestaje być jedynie narzędziem, a staje się siłą kształtującą gospodarki, branże i społeczeństwa. W 2025 roku AI to już nie obietnica przyszłości, ale realna przewaga konkurencyjna dla firm, priorytet narodowy dla rządów oraz technologia zmieniająca codzienne życie. Termin ten oddaje zarówno bezprecedensową moc zaawansowanych systemów AI, jak i globalny wyścig o to, kto najlepiej i najbezpieczniej potrafi ją wykorzystać.

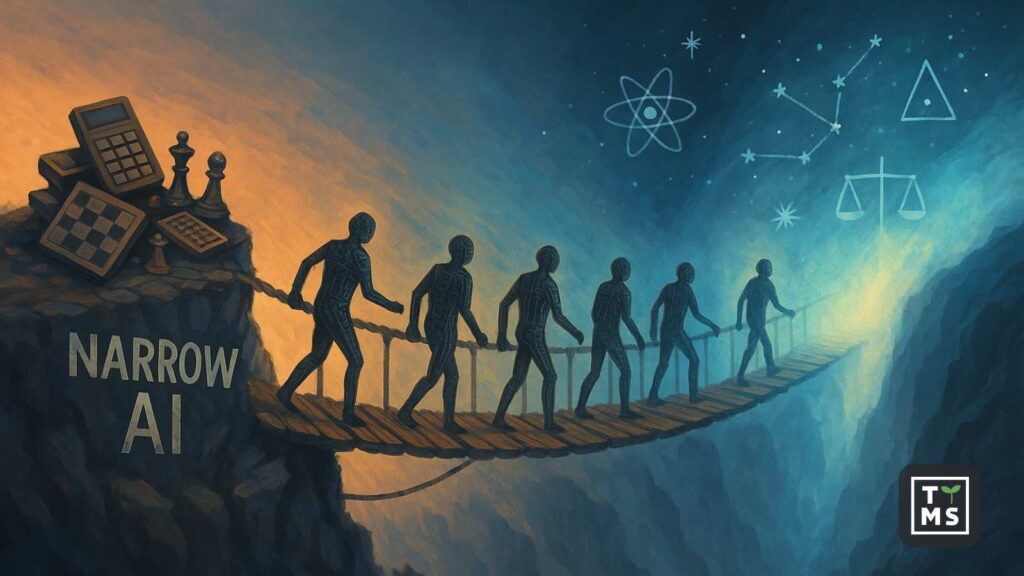

Jak blisko jesteśmy osiągnięcia ogólnej sztucznej inteligencji (AGI)?

Nie osiągnęliśmy jeszcze poziomu AGI – czyli systemów AI zdolnych do wykonywania dowolnych zadań intelektualnych, które potrafi człowiek – ale zbliżamy się do tego celu. Postęp w ostatnich latach jest imponujący: modele są już multimodalne (przetwarzają tekst, obraz, dźwięk i inne dane), lepiej rozumują, potrafią korzystać z narzędzi i API, a nawet wchodzić w interakcje ze światem fizycznym dzięki robotyce. Choć prawdziwe AGI wciąż pozostaje celem długoterminowym, wielu ekspertów uważa, że zaczynają się pojawiać jego podstawowe komponenty. Nadal jednak przed nami poważne wyzwania techniczne, etyczne i regulacyjne, zanim AGI stanie się rzeczywistością.

Jakie są główne wyzwania stojące dziś przed AI?

Rozwój sztucznej inteligencji nabiera tempa, ale wiąże się z poważnymi wyzwaniami. Po stronie regulacyjnej brakuje jednolitych globalnych standardów, co powoduje niepewność prawną dla twórców i użytkowników. Technicznie – modele są kosztowne w trenowaniu i działaniu, wymagają ogromnych zasobów obliczeniowych i energii. Narasta też niepokój o jakość i legalność danych treningowych, zwłaszcza w kontekście treści objętych prawem autorskim i danych osobowych. Kluczowe pozostają również kwestie interpretowalności i bezpieczeństwa – wiele systemów AI działa jak „czarna skrzynka”, a nawet ich twórcy nie zawsze potrafią przewidzieć ich zachowanie. Jednym z największych nierozwiązanych problemów jest zapewnienie, że modele pozostają zgodne z ludzkimi wartościami i intencjami.

Które branże są najbardziej transformowane przez AI?

Sztuczna inteligencja wpływa niemal na każdy sektor, ale jej oddziaływanie jest szczególnie widoczne w takich obszarach jak:

- Finanse: wykrywanie oszustw, ocena ryzyka i automatyzacja zgodności z regulacjami.

- Ochrona zdrowia: diagnostyka, odkrywanie leków i analiza danych pacjentów.

- Edukacja i e-learning: spersonalizowane narzędzia do nauki i automatyczne tworzenie treści edukacyjnych.

- Handel detaliczny i e-commerce: systemy rekomendacji, chatboty i prognozowanie popytu.

- Usługi prawne: analiza dokumentów, przegląd umów i automatyzacja badań prawnych.

- Produkcja i logistyka: predykcyjne utrzymanie ruchu, automatyzacja procesów i robotyka.

Firmy wdrażające AI często obniżają koszty, poprawiają doświadczenia klientów i podejmują szybsze decyzje oparte na danych.

Jak firmy mogą odpowiedzialnie wdrażać AI?

Odpowiedzialne wdrażanie sztucznej inteligencji zaczyna się od zrozumienia, gdzie AI może przynieść realną wartość – czy to poprzez usprawnienie operacji, lepsze podejmowanie decyzji, czy poprawę doświadczeń użytkownika. Następnie warto:

- określić zaufanych partnerów technologicznych,

- ocenić gotowość danych i procesów,

- zapewnić zgodność z regulacjami lokalnymi i międzynarodowymi.

Kluczowe jest projektowanie rozwiązań w sposób etyczny – AI powinna być przejrzysta, sprawiedliwa i bezpieczna. Stałe monitorowanie działania modeli, zbieranie opinii użytkowników oraz stosowanie mechanizmów awaryjnych pomagają ograniczać ryzyko. Firmy powinny traktować sztuczną inteligencję nie jako jednorazową implementację, lecz jako element długofalowej strategii rozwoju.